”激活函数“ 的搜索结果

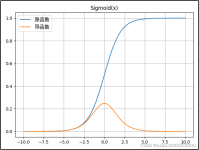

常见激活函数的图,用excel画的,有图有数据,高清缩放不变形,论文必备,包括Sigmoid、Tanh、ReLU、LeakyReLU

常用激活函数总结(深度学习)

标签: 深度学习

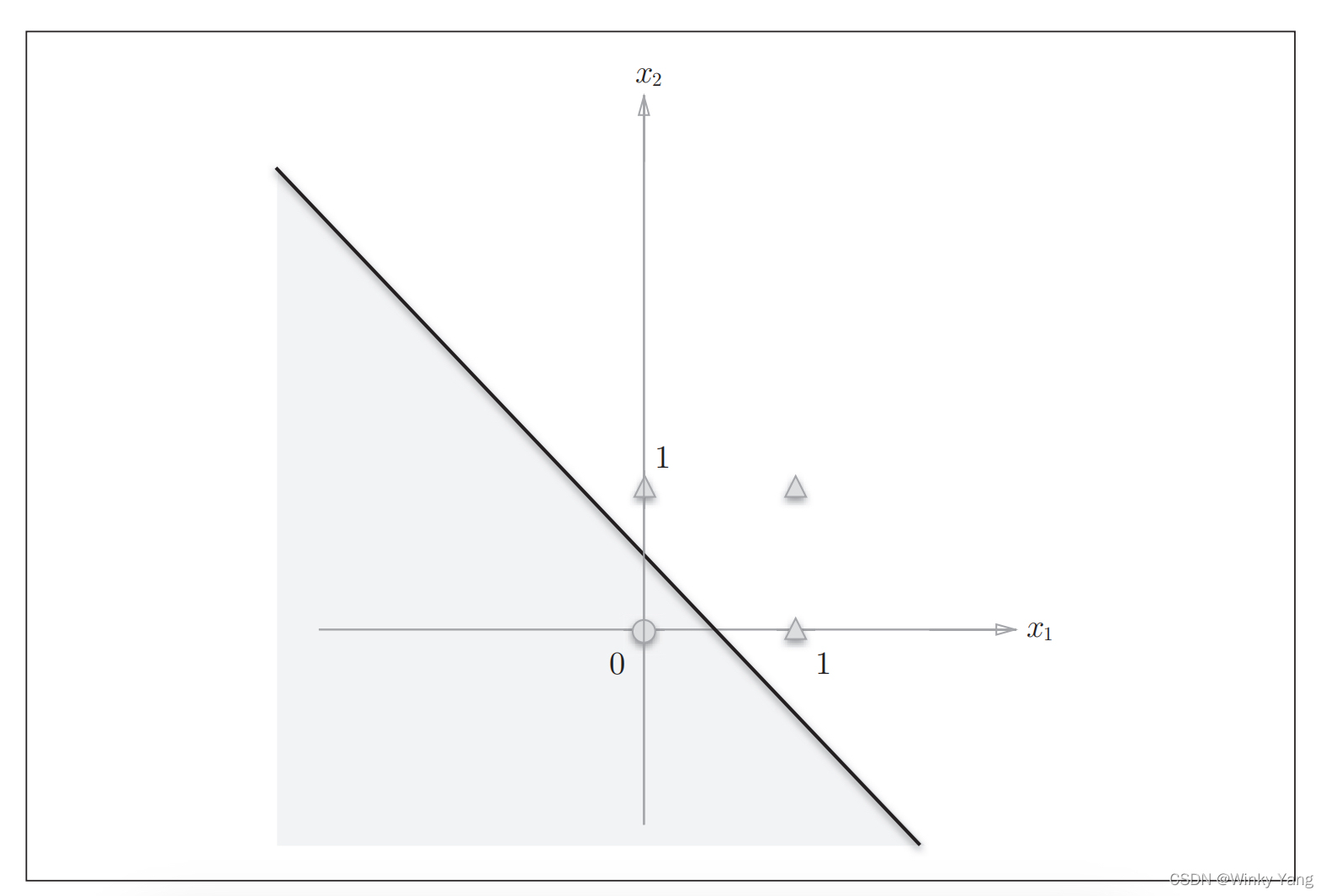

1.为什么要使用激活函数 因为线性函数能拟合的模型太少,多层线性神经网络的叠加仍为线性,加上非线性可以改善拟合效果。 2.激活函数的要求 非线性,可微(反向传播)。 3.常用的激活函数 Sigmoid 能够把输入的连续...

激活函数(Activation Function)、Sigmoid、tanh、ReLU、Leaky ReLU、ELU、PReLU、Softmax、Swish、Maxout、Softplus

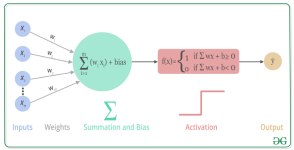

学习神经网络的时候我们总是听到激活函数这个词,而且很多资料都会提到常用的激活函数,比如Sigmoid函数、tanh函数、Relu函数。那么我们就来详细了解下激活函数方方面面的知识。本文的内容包括几个部分: 什么是...

根据每一层前面的激活、权重和偏置,我们要为下一层的每个激活计算一个值,但在将该值发送给下一层之前,要是用激活函数对这个输出进行缩放。 sigmoid函数 sigmoid函数是一个logistic函数,意思是说不管输入什么,...

主要介绍了python深度学习中的4种激活函数,帮助大家更好的进行深度学习,感兴趣的朋友可以了解下

在实现多层感知机代码实现中使用了ReLU激活函数: ReLU(x)=max(x,0)ReLU(x)=max(x,0)ReLU(x)=max(x,0) 形状大概是这样的 这里根据几个问题来进行回答解释 为什么要使用激活函数呢? 简单来说激活函数的作用就是将...

前言:因为研究工作的需要,要更改激活函数以适应自己的网络模型,但是单纯的函数替换会训练导致不能收敛。这里还有些不清楚为什么,希望有人可以给出解释。查了一些博客,发现了解决之道。下面将解决过程贴出来供...

神经网络中的激活函数就是用来判断我们所计算的信息是否达到了往后面传输的条件。 为什么激活函数都是非线性的 因为如果使用线性的激活函数,那么input跟output之间的关系始终为线性的,这样完全可以不使用网络结构...

神经网络激活函数代码,有代码有图,可以直接用来学习使用。

激活函数系列中提及到的激活函数包括:Sigmoid、Tanh、ReLU、Leaky ReLU、PReLU、Swish、ELU、SELU、GELU、Softmax、Softplus、Mish、Maxout、HardSigmoid、HardTanh、Hardswish、HardShrink、SoftShrink、...

主要介绍了PyTorch中常用的激活函数的方法示例,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧

1、pytorch激活函数示例及其可视化代码;

GELU (Gaussian Error Linear Units) 是一种基于高斯误差函数的激活函数,相较于 ReLU 等激活函数,GELU 更加平滑,有助于提高训练过程的收敛速度和性能。

本资源主要是可视化各种激活函数:Relu,sigmoid ,swish,mish等,只需要依赖numpy,不需要安装pytorch,只是一个简单的demo

多层神经网络中,上层节点的输出和下层节点的输入之间具有一个函数关系,这个函数称为激活函数(Activation Function)。

推荐文章

- 超简单的excel表导入成Json数据方法--VUE项目(xlsx.js)_excel导入json数据-程序员宅基地

- 基于Java+SpringBoot+Vue前后端分离电商应用系统设计和实现_电商框架前后端-程序员宅基地

- 【转载】Linux-2.6.32.2内核在mini2440上的移植(三)---DM9000网卡驱动移植_rootfs dm9000 移植-程序员宅基地

- java双层循环内存_java - 重写双嵌套for循环作为Java 8流 - 堆栈内存溢出-程序员宅基地

- UPC 2021个人训练赛第11场 题解_761128315856702-程序员宅基地

- 数据结构--实验1--栈的操作-程序员宅基地

- 【Git】本地git服务器搭建_git本地服务器搭建-程序员宅基地

- ORA-03113: end-of-file on communication channel 解决方法_comandget db sessionid)时酸生周题(ora-03113: end-of-fil-程序员宅基地

- svn版本管理工具_svn版本管理工具介绍-程序员宅基地

- 【电力系统分析复习笔记】电力系统的基本概念_电力系统分析笔记-程序员宅基地