[python爬虫] selenium爬取局部动态刷新网站(URL始终固定)_driver.find_element(by.xpath .get_attribute()-程序员宅基地

技术标签: 网络爬虫 Python学习系列 Python爬虫 Python网络爬虫 局部刷新 翻页跳转 Selenium Python

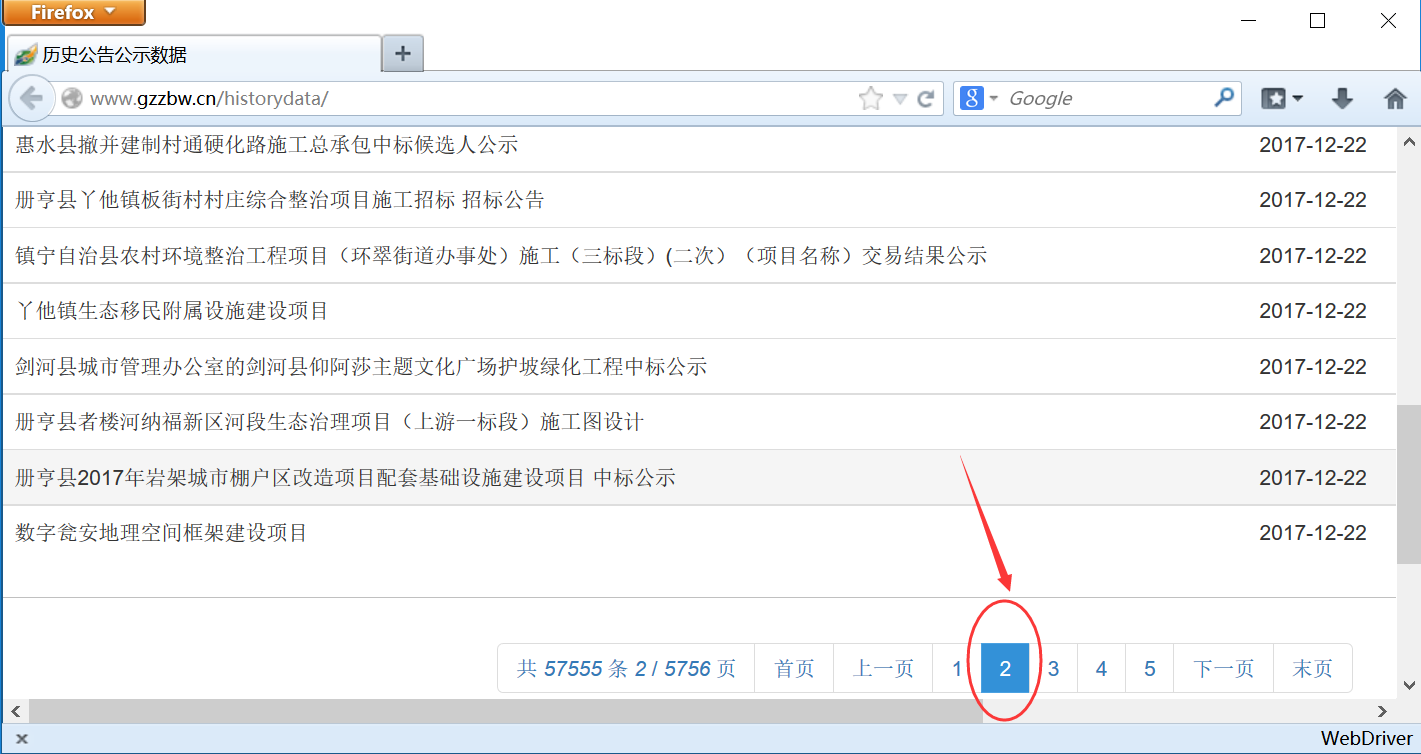

在爬取网站过程中,通常会遇到局部动态刷新情况,当你点击“下一页”或某一页时,它的数据就进行刷新,但其顶部的URL始终不变。这种局部动态刷新的网站,怎么爬取数据呢?某网站数据显示如下图所示,当点击“第五页”之时,其URL始终不变,传统的网站爬取方法是无法拼接这类链接的,所以本篇文章主要解决这个问题。

本文主要采用Selenium爬取局部动态刷新的网站,获取“下一页”按钮实现自动点击跳转,再依次爬取每一页的内容。希望对您有所帮助,尤其是遇到同样问题的同学,如果文章中出现错误或不足之处,还请海涵~

一. Selenium爬取第一页信息

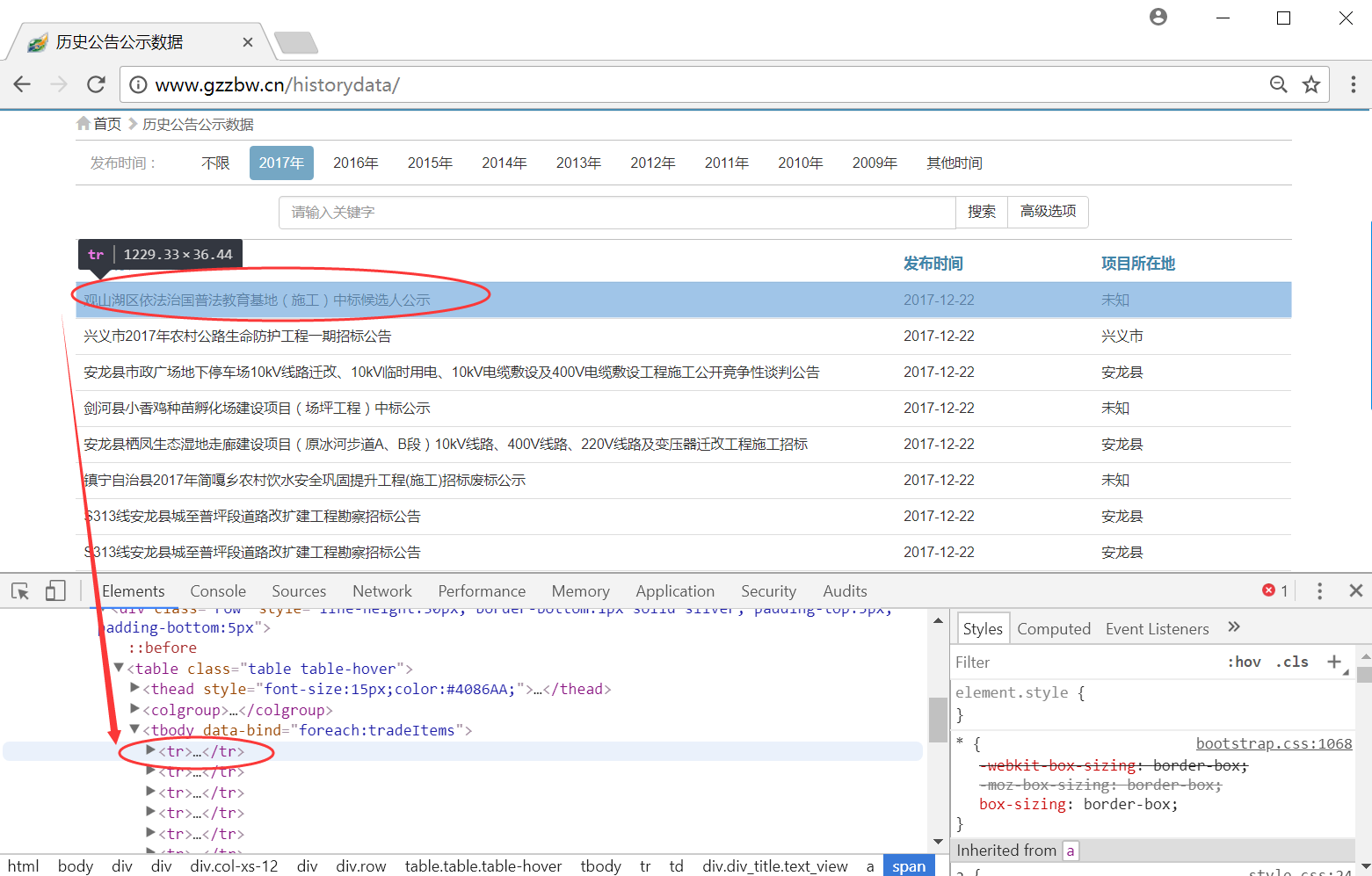

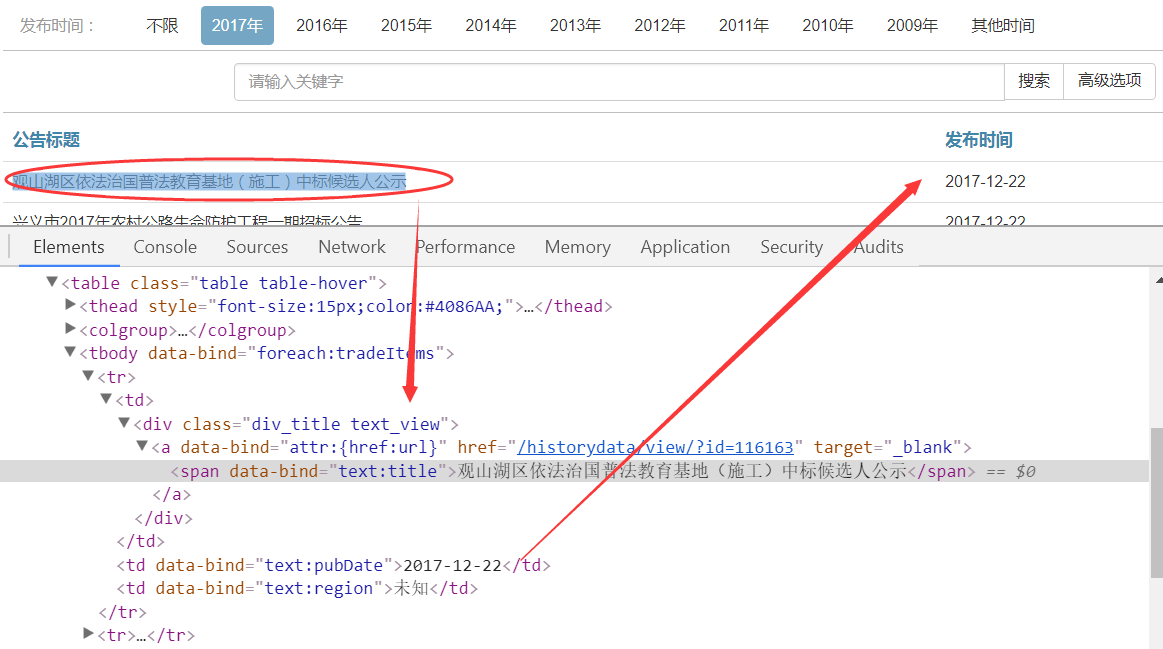

首先,我们尝试使用Selenium爬取第一页的内容,采用浏览器右键“审查”元素,可以看到对应的HTML源代码,如下图所示,可以看到,每一行工程信息都位于<table class="table table-hover">节点下的<tr>...</tr>中。

然后我们再展开其中一个<tr>...</tr>节点,看它的源码详情,如下图所示,包括公告标题、发布时间、项目所在地。如果我们需要抓取公告标题,则定位<div class="div_title text_view">节点,再获取标题内容和超链接。

完整代码如下:

# coding=utf-8

from selenium import webdriver

import re

import time

import os

print "start"

#打开Firefox浏览器 设定等待加载时间

driver = webdriver.Firefox()

#定位节点

url = 'http:/www.xxxx.com/'

print url

driver.get(url)

content = driver.find_elements_by_xpath("//div[@class='div_title text_view']")

for u in content:

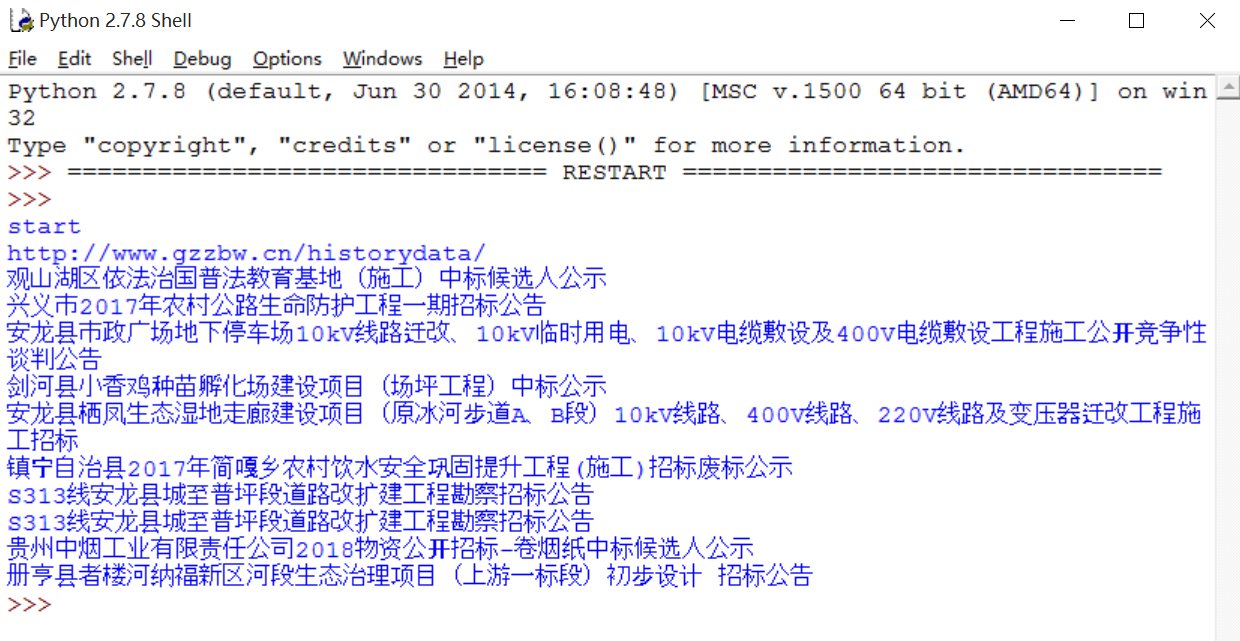

print u.text输出内容如下图所示:

PS:由于网站安全问题,我不直接给出网址,主要给出爬虫的核心思想。同时,下面的代码我也没有给出网址,但思路一样,请大家替换成自己的局部刷新网址进行测试。

二. Selenium实现局部动态刷新爬取

接下来我们想爬取第2页的网站内容,其代码步骤如下:

1.定位驱动:driver = webdriver.Firefox()

2.访问网址:driver.get(url)

3.定位节点获取第一页内容并爬取:driver.find_elements_by_xpath()

4.获取“下一页”按钮,并调用click()函数点击跳转

5.爬取第2页的网站内容:driver.find_elements_by_xpath()

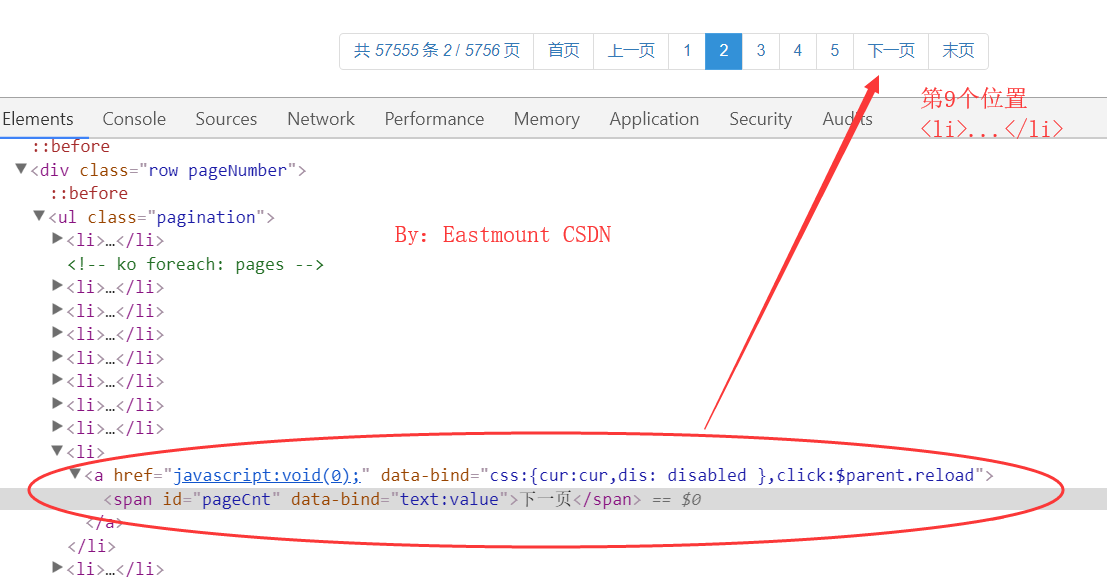

其核心步骤是获取“下一页”按钮,并调用Selenium自动点击按钮技术,从而实现跳转,之后再爬取第2页内容。“下一页”按钮的源代码如下图所示:

其中,“下一页”按钮始终在第9个<li>...</li>位置,则核心代码如下:

nextPage = driver.find_element_by_xpath("//ul[@class='pagination']/li[9]/a")

nextPage.click()

完整代码如下:

# coding=utf-8

from selenium import webdriver

import re

import time

import os

print "start"

driver = webdriver.Firefox()

url = 'http://www.XXXX.com/'

print url

driver.get(url)

#项目名称

titles = driver.find_elements_by_xpath("//div[@class='div_title text_view']")

for u in titles:

print u.text

#超链接

urls = driver.find_elements_by_xpath("//div[@class='div_title text_view']/a")

for u in urls:

print u.get_attribute("href")

#时间

times = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[2]")

for u in times:

print u.text

#地点

places = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[3]")

for u in places:

print u.text

#点击下一页

nextPage = driver.find_element_by_xpath("//ul[@class='pagination']/li[9]/a")

print nextPage.text

nextPage.click()

time.sleep(5)

#爬取第2页数据

content = driver.find_elements_by_xpath("//div[@class='div_title text_view']")

for u in content:

print u.text>>>

start

http://www.xxxx.com/

观山湖区依法治国普法教育基地(施工)中标候选人公示

兴义市2017年农村公路生命防护工程一期招标公告

安龙县市政广场地下停车场10kV线路迁改、10kV临时用电、10kV电缆敷设及400V电缆敷设工程施工公开竞争性谈判公告

剑河县小香鸡种苗孵化场建设项目(场坪工程)中标公示

安龙县栖凤生态湿地走廊建设项目(原冰河步道A、B段)10kV线路、400V线路、220V线路及变压器迁改工程施工招标

镇宁自治县2017年简嘎乡农村饮水安全巩固提升工程(施工)招标废标公示

S313线安龙县城至普坪段道路改扩建工程勘察招标公告

S313线安龙县城至普坪段道路改扩建工程勘察招标公告

贵州中烟工业有限责任公司2018物资公开招标-卷烟纸中标候选人公示

册亨县者楼河纳福新区河段生态治理项目(上游一标段)初步设计 招标公告

http://www.gzzbw.cn/historydata/view/?id=116163

http://www.gzzbw.cn/historydata/view/?id=114995

http://www.gzzbw.cn/historydata/view/?id=115720

http://www.gzzbw.cn/historydata/view/?id=116006

http://www.gzzbw.cn/historydata/view/?id=115719

http://www.gzzbw.cn/historydata/view/?id=115643

http://www.gzzbw.cn/historydata/view/?id=114966

http://www.gzzbw.cn/historydata/view/?id=114965

http://www.gzzbw.cn/historydata/view/?id=115400

http://www.gzzbw.cn/historydata/view/?id=116031

2017-12-22

2017-12-22

2017-12-22

2017-12-22

2017-12-22

2017-12-22

2017-12-22

2017-12-22

2017-12-22

2017-12-22

未知

兴义市

安龙县

未知

安龙县

未知

安龙县

安龙县

未知

册亨县

下一页

册亨县丫他镇板其村埃近1~2组村庄综合整治项目

册亨县者楼河纳福新区河段生态治理项目(上游一标段)勘察 招标公告

惠水县撤并建制村通硬化路施工总承包中标候选人公示

册亨县丫他镇板街村村庄综合整治项目施工招标 招标公告

镇宁自治县农村环境整治工程项目(环翠街道办事处)施工(三标段)(二次)(项目名称)交易结果公示

丫他镇生态移民附属设施建设项目

剑河县城市管理办公室的剑河县仰阿莎主题文化广场护坡绿化工程中标公示

册亨县者楼河纳福新区河段生态治理项目(上游一标段)施工图设计

册亨县2017年岩架城市棚户区改造项目配套基础设施建设项目 中标公示

数字瓮安地理空间框架建设项目

>>>

三. Selenium爬取详情页面

上面爬取了每行公告信息的详情页面超链接(URL),本来我准备采用BeautifulSoup爬虫爬取详情页面信息的,但是被拦截了,详情页面如下图所示:

# coding=utf-8

from selenium import webdriver

from selenium.webdriver.common.keys import Keys

import re

import time

import os

print "start"

#打开Firefox浏览器

driver = webdriver.Firefox()

driver2 = webdriver.Firefox()

url = 'http://www.xxxx.com/'

print url

driver.get(url)

#项目名称

titles = driver.find_elements_by_xpath("//div[@class='div_title text_view']")

#超链接

urls = driver.find_elements_by_xpath("//div[@class='div_title text_view']/a")

num = []

for u in urls:

href = u.get_attribute("href")

driver2.get(href)

con = driver2.find_element_by_xpath("//div[@class='col-xs-9']")

#print con.text

num.append(con.text)

#时间

times = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[2]")

#地点

places = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[3]")

#输出所有结果

print len(num)

i = 0

while i<len(num):

print titles[i].text

print urls[i].get_attribute("href")

print times[i].text

print places[i].text

print num[i]

print ""

i = i + 1

#点击下一页

j = 0

while j<5:

nextPage = driver.find_element_by_xpath("//ul[@class='pagination']/li[9]/a")

print nextPage.text

nextPage.click()

time.sleep(5)

#项目名称

titles = driver.find_elements_by_xpath("//div[@class='div_title text_view']")

#超链接

urls = driver.find_elements_by_xpath("//div[@class='div_title text_view']/a")

num = []

for u in urls:

href = u.get_attribute("href")

driver2.get(href)

con = driver2.find_element_by_xpath("//div[@class='col-xs-9']")

num.append(con.text)

#时间

times = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[2]")

#地点

places = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[3]")

#输出所有结果

print len(num)

i = 0

while i<len(num):

print titles[i].text

print urls[i].get_attribute("href")

print times[i].text

print places[i].text

print num[i]

print ""

i = i + 1

j = j + 1

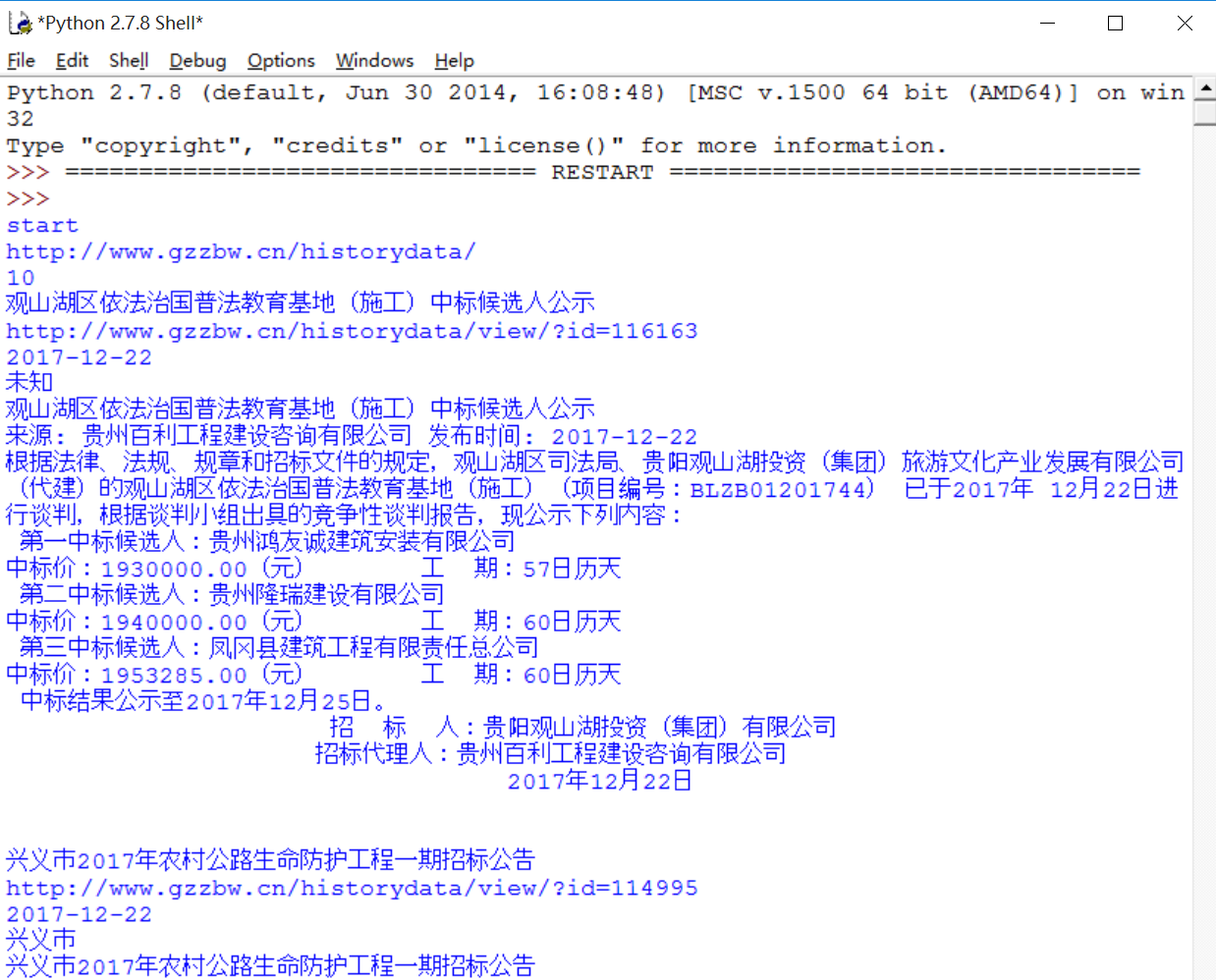

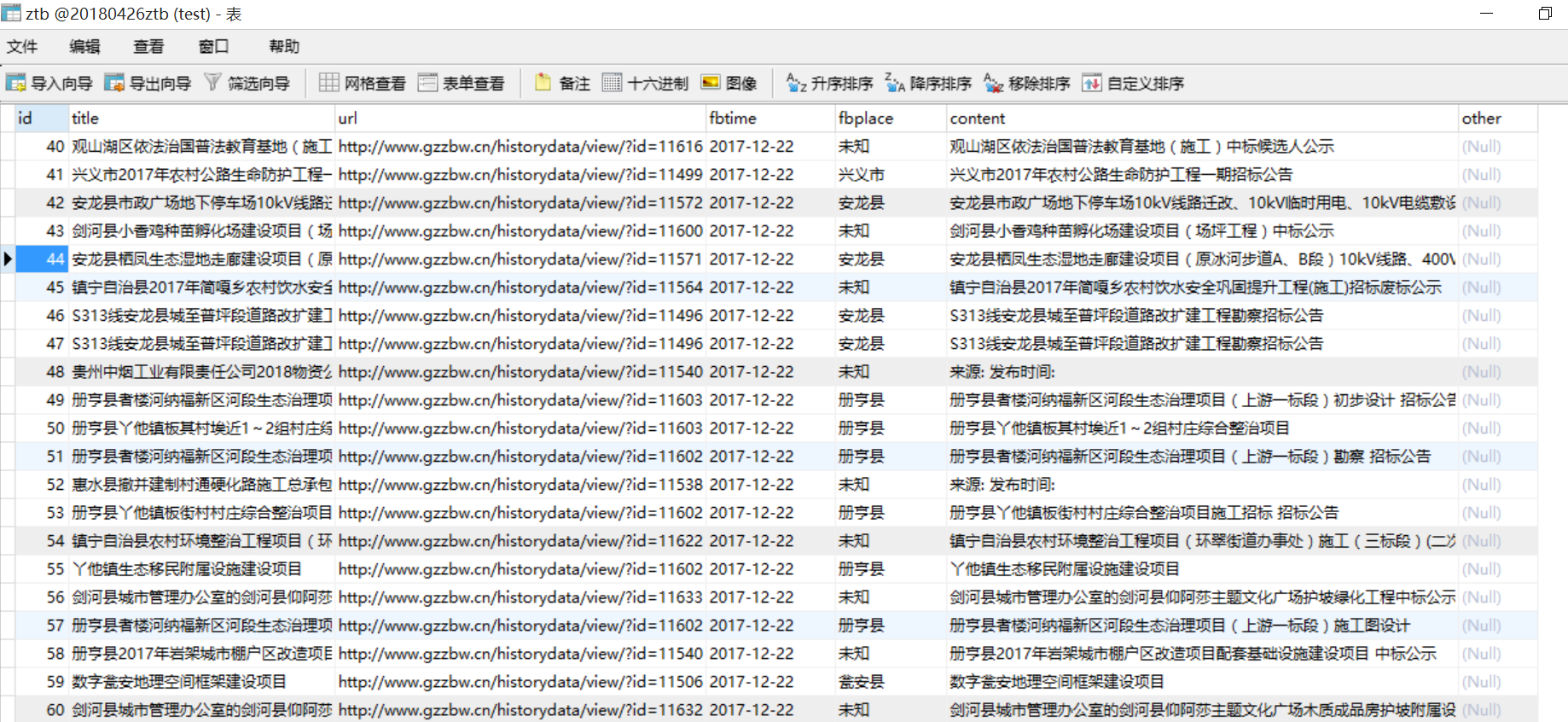

注意作者定义了一个while循环,一次性输出一条完整的招标信息,代码如下:

print len(num)

i = 0

while i<len(num):

print titles[i].text

print urls[i].get_attribute("href")

print times[i].text

print places[i].text

print num[i]

print ""

i = i + 1输出结果如下图所示:

其中一条完整的结果如下所示:

观山湖区依法治国普法教育基地(施工)中标候选人公示

http://www.gzzbw.cn/historydata/view/?id=116163

2017-12-22

未知

观山湖区依法治国普法教育基地(施工)中标候选人公示

来源: 贵州百利工程建设咨询有限公司 发布时间: 2017-12-22

根据法律、法规、规章和招标文件的规定,观山湖区司法局、贵阳观山湖投资(集团)旅游文化产业发展有限公司(代建)的观山湖区依法治国普法

教育基地(施工)(项目编号:BLZB01201744) 已于2017年 12月22日进行谈判,根据谈判小组出具的竞争性谈判报告,现公示下列内容:

第一中标候选人:贵州鸿友诚建筑安装有限公司

中标价:1930000.00(元) 工 期:57日历天

第二中标候选人:贵州隆瑞建设有限公司

中标价:1940000.00(元) 工 期:60日历天

第三中标候选人:凤冈县建筑工程有限责任总公司

中标价:1953285.00(元) 工 期:60日历天

中标结果公示至2017年12月25日。

招 标 人:贵阳观山湖投资(集团)有限公司

招标代理人:贵州百利工程建设咨询有限公司

2017年12月22日

# coding=utf-8

from selenium import webdriver

from selenium.webdriver.common.keys import Keys

import selenium.webdriver.support.ui as ui

import re

import time

import os

import codecs

from bs4 import BeautifulSoup

import urllib

import MySQLdb

#存储数据库

#参数:公告名称 发布时间 发布地点 发布内容

def DatabaseInfo(title,url,fbtime,fbplace,content):

try:

conn = MySQLdb.connect(host='localhost',user='root',

passwd='123456',port=3306, db='20180426ztb')

cur=conn.cursor() #数据库游标

#报错:UnicodeEncodeError: 'latin-1' codec can't encode character

conn.set_character_set('utf8')

cur.execute('SET NAMES utf8;')

cur.execute('SET CHARACTER SET utf8;')

cur.execute('SET character_set_connection=utf8;')

#SQL语句 智联招聘(zlzp)

sql = '''insert into ztb

(title, url, fbtime, fbplace, content)

values(%s, %s, %s, %s, %s);'''

cur.execute(sql, (title,url,fbtime,fbplace,content))

print '数据库插入成功'

#异常处理

except MySQLdb.Error,e:

print "Mysql Error %d: %s" % (e.args[0], e.args[1])

finally:

cur.close()

conn.commit()

conn.close()

print "start"

#打开Firefox浏览器

driver = webdriver.Firefox()

driver2 = webdriver.Firefox()

url = 'http://www.gzzbw.cn/historydata/'

print url

driver.get(url)

#项目名称

titles = driver.find_elements_by_xpath("//div[@class='div_title text_view']")

#超链接

urls = driver.find_elements_by_xpath("//div[@class='div_title text_view']/a")

num = []

for u in urls:

href = u.get_attribute("href")

driver2.get(href)

con = driver2.find_element_by_xpath("//div[@class='col-xs-9']")

#print con.text

num.append(con.text)

#时间

times = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[2]")

#地点

places = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[3]")

#输出所有结果

print len(num)

i = 0

while i<len(num):

print titles[i].text

print urls[i].get_attribute("href")

print times[i].text

print places[i].text

print num[i]

print ""

DatabaseInfo(titles[i].text, urls[i].get_attribute("href"), times[i].text,

places[i].text, num[i])

i = i + 1

#点击下一页

j = 0

while j<100:

nextPage = driver.find_element_by_xpath("//ul[@class='pagination']/li[9]/a")

print nextPage.text

nextPage.click()

time.sleep(5)

#项目名称

titles = driver.find_elements_by_xpath("//div[@class='div_title text_view']")

#超链接

urls = driver.find_elements_by_xpath("//div[@class='div_title text_view']/a")

num = []

for u in urls:

href = u.get_attribute("href")

driver2.get(href)

con = driver2.find_element_by_xpath("//div[@class='col-xs-9']")

num.append(con.text)

#时间

times = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[2]")

#地点

places = driver.find_elements_by_xpath("//table[@class='table table-hover']/tbody/tr/td[3]")

#输出所有结果

print len(num)

i = 0

while i<len(num):

print titles[i].text

print urls[i].get_attribute("href")

print times[i].text

print places[i].text

print num[i]

print ""

DatabaseInfo(titles[i].text, urls[i].get_attribute("href"), times[i].text,

places[i].text, num[i])

i = i + 1

print u"已爬取页码:", (j+2)

j = j + 1

最后希望文章对您有所帮助,尤其是要爬取局部刷新的同学,

如果文章中出现错误或不足之处,还请海涵~

(By:Eastmount 2018-04-26 早上11点半 http://blog.csdn.net/eastmount/ )

智能推荐

从零开始搭建Hadoop_创建一个hadoop项目-程序员宅基地

文章浏览阅读331次。第一部分:准备工作1 安装虚拟机2 安装centos73 安装JDK以上三步是准备工作,至此已经完成一台已安装JDK的主机第二部分:准备3台虚拟机以下所有工作最好都在root权限下操作1 克隆上面已经有一台虚拟机了,现在对master进行克隆,克隆出另外2台子机;1.1 进行克隆21.2 下一步1.3 下一步1.4 下一步1.5 根据子机需要,命名和安装路径1.6 ..._创建一个hadoop项目

心脏滴血漏洞HeartBleed CVE-2014-0160深入代码层面的分析_heartbleed代码分析-程序员宅基地

文章浏览阅读1.7k次。心脏滴血漏洞HeartBleed CVE-2014-0160 是由heartbeat功能引入的,本文从深入码层面的分析该漏洞产生的原因_heartbleed代码分析

java读取ofd文档内容_ofd电子文档内容分析工具(分析文档、签章和证书)-程序员宅基地

文章浏览阅读1.4k次。前言ofd是国家文档标准,其对标的文档格式是pdf。ofd文档是容器格式文件,ofd其实就是压缩包。将ofd文件后缀改为.zip,解压后可看到文件包含的内容。ofd文件分析工具下载:点我下载。ofd文件解压后,可以看到如下内容: 对于xml文件,可以用文本工具查看。但是对于印章文件(Seal.esl)、签名文件(SignedValue.dat)就无法查看其内容了。本人开发一款ofd内容查看器,..._signedvalue.dat

基于FPGA的数据采集系统(一)_基于fpga的信息采集-程序员宅基地

文章浏览阅读1.8w次,点赞29次,收藏313次。整体系统设计本设计主要是对ADC和DAC的使用,主要实现功能流程为:首先通过串口向FPGA发送控制信号,控制DAC芯片tlv5618进行DA装换,转换的数据存在ROM中,转换开始时读取ROM中数据进行读取转换。其次用按键控制adc128s052进行模数转换100次,模数转换数据存储到FIFO中,再从FIFO中读取数据通过串口输出显示在pc上。其整体系统框图如下:图1:FPGA数据采集系统框图从图中可以看出,该系统主要包括9个模块:串口接收模块、按键消抖模块、按键控制模块、ROM模块、D.._基于fpga的信息采集

微服务 spring cloud zuul com.netflix.zuul.exception.ZuulException GENERAL-程序员宅基地

文章浏览阅读2.5w次。1.背景错误信息:-- [http-nio-9904-exec-5] o.s.c.n.z.filters.post.SendErrorFilter : Error during filteringcom.netflix.zuul.exception.ZuulException: Forwarding error at org.springframework.cloud..._com.netflix.zuul.exception.zuulexception

邻接矩阵-建立图-程序员宅基地

文章浏览阅读358次。1.介绍图的相关概念 图是由顶点的有穷非空集和一个描述顶点之间关系-边(或者弧)的集合组成。通常,图中的数据元素被称为顶点,顶点间的关系用边表示,图通常用字母G表示,图的顶点通常用字母V表示,所以图可以定义为: G=(V,E)其中,V(G)是图中顶点的有穷非空集合,E(G)是V(G)中顶点的边的有穷集合1.1 无向图:图中任意两个顶点构成的边是没有方向的1.2 有向图:图中..._给定一个邻接矩阵未必能够造出一个图

随便推点

MDT2012部署系列之11 WDS安装与配置-程序员宅基地

文章浏览阅读321次。(十二)、WDS服务器安装通过前面的测试我们会发现,每次安装的时候需要加域光盘映像,这是一个比较麻烦的事情,试想一个上万个的公司,你天天带着一个光盘与光驱去给别人装系统,这将是一个多么痛苦的事情啊,有什么方法可以解决这个问题了?答案是肯定的,下面我们就来简单说一下。WDS服务器,它是Windows自带的一个免费的基于系统本身角色的一个功能,它主要提供一种简单、安全的通过网络快速、远程将Window..._doc server2012上通过wds+mdt无人值守部署win11系统.doc

python--xlrd/xlwt/xlutils_xlutils模块可以读xlsx吗-程序员宅基地

文章浏览阅读219次。python–xlrd/xlwt/xlutilsxlrd只能读取,不能改,支持 xlsx和xls 格式xlwt只能改,不能读xlwt只能保存为.xls格式xlutils能将xlrd.Book转为xlwt.Workbook,从而得以在现有xls的基础上修改数据,并创建一个新的xls,实现修改xlrd打开文件import xlrdexcel=xlrd.open_workbook('E:/test.xlsx') 返回值为xlrd.book.Book对象,不能修改获取sheett_xlutils模块可以读xlsx吗

关于新版本selenium定位元素报错:‘WebDriver‘ object has no attribute ‘find_element_by_id‘等问题_unresolved attribute reference 'find_element_by_id-程序员宅基地

文章浏览阅读8.2w次,点赞267次,收藏656次。运行Selenium出现'WebDriver' object has no attribute 'find_element_by_id'或AttributeError: 'WebDriver' object has no attribute 'find_element_by_xpath'等定位元素代码错误,是因为selenium更新到了新的版本,以前的一些语法经过改动。..............._unresolved attribute reference 'find_element_by_id' for class 'webdriver

DOM对象转换成jQuery对象转换与子页面获取父页面DOM对象-程序员宅基地

文章浏览阅读198次。一:模态窗口//父页面JSwindow.showModalDialog(ifrmehref, window, 'dialogWidth:550px;dialogHeight:150px;help:no;resizable:no;status:no');//子页面获取父页面DOM对象//window.showModalDialog的DOM对象var v=parentWin..._jquery获取父window下的dom对象

什么是算法?-程序员宅基地

文章浏览阅读1.7w次,点赞15次,收藏129次。算法(algorithm)是解决一系列问题的清晰指令,也就是,能对一定规范的输入,在有限的时间内获得所要求的输出。 简单来说,算法就是解决一个问题的具体方法和步骤。算法是程序的灵 魂。二、算法的特征1.可行性 算法中执行的任何计算步骤都可以分解为基本可执行的操作步,即每个计算步都可以在有限时间里完成(也称之为有效性) 算法的每一步都要有确切的意义,不能有二义性。例如“增加x的值”,并没有说增加多少,计算机就无法执行明确的运算。 _算法

【网络安全】网络安全的标准和规范_网络安全标准规范-程序员宅基地

文章浏览阅读1.5k次,点赞18次,收藏26次。网络安全的标准和规范是网络安全领域的重要组成部分。它们为网络安全提供了技术依据,规定了网络安全的技术要求和操作方式,帮助我们构建安全的网络环境。下面,我们将详细介绍一些主要的网络安全标准和规范,以及它们在实际操作中的应用。_网络安全标准规范