保姆教程 | YOLOv5在建筑工地中安全帽佩戴检测的应用-程序员宅基地

技术标签: YOLO

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达教程来自:https://github.com/PeterH0323/Smart_Construction

一、YOLO v5训练自己数据集教程

1.1 创建自己的数据集配置文件

1.2 创建每个图片对应的标签文件

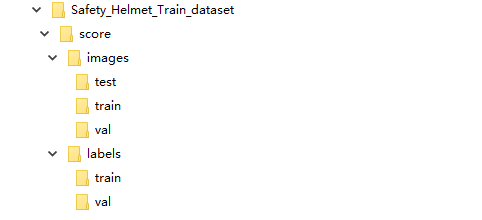

1.3 文件放置规范

1.4 聚类得出先验框(可选)

1.5 选择一个你需要的模型

1.6 开始训练

1.7 看训练之后的结果

二、侦测

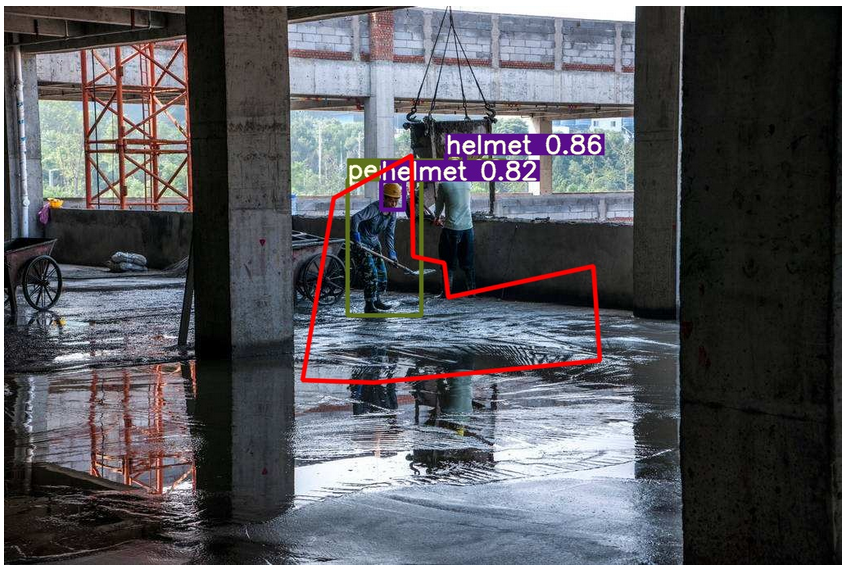

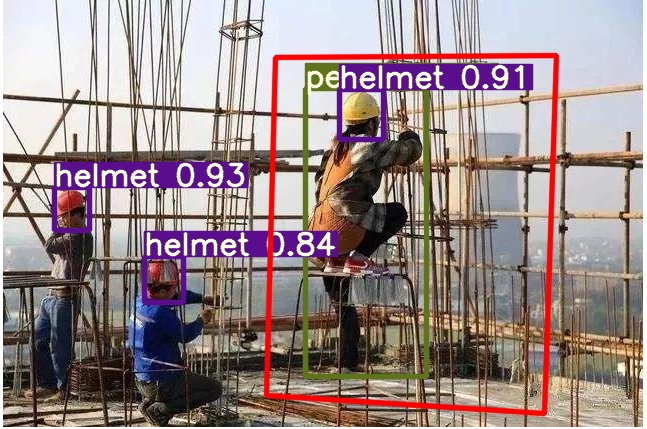

三、检测危险区域内是否有人

3.1 危险区域标注方式

3.2 执行侦测

3.3 效果:在危险区域里面的人体会被 红色框 选出来

四、生成 ONNX

五、增加数据集的分类

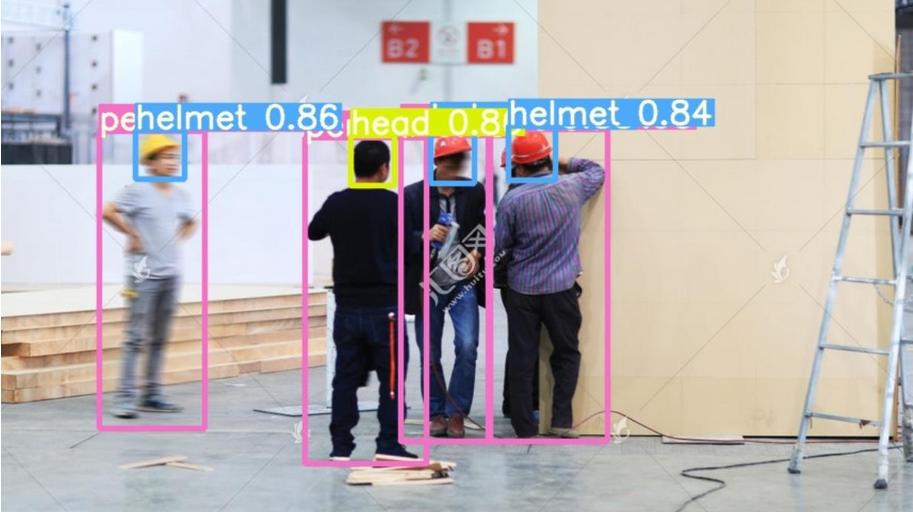

该项目是使用 YOLOv5 v2.x 来训练在智能工地安全领域中头盔目标检测的应用,先来一波演示!

指标

yolov5s 为基础训练,epoch = 50

| 分类 | P | R | mAP0.5 |

|---|---|---|---|

| 总体 | 0.884 | 0.899 | 0.888 |

| 人体 | 0.846 | 0.893 | 0.877 |

| 头 | 0.889 | 0.883 | 0.871 |

| 安全帽 | 0.917 | 0.921 | 0.917 |

对应的权重文件:https://pan.baidu.com/share/init?surl=ELPhtW-Q4G8UqEr4YrV_5A,提取码: b981

yolov5m 为基础训练,epoch = 100

| 分类 | P | R | mAP0.5 |

|---|---|---|---|

| 总体 | 0.886 | 0.915 | 0.901 |

| 人体 | 0.844 | 0.906 | 0.887 |

| 头 | 0.9 | 0.911 | 0.9 |

| 安全帽 | 0.913 | 0.929 | 0.916 |

对应的权重文件:https://pan.baidu.com/share/init?surl=0hlKrgpxVsw4d_vHnPHwEA,提取码: psst

yolov5l 为基础训练,epoch = 100

| 分类 | P | R | mAP0.5 |

|---|---|---|---|

| 总体 | 0.892 | 0.919 | 0.906 |

| 人体 | 0.856 | 0.914 | 0.897 |

| 头 | 0.893 | 0.913 | 0.901 |

| 安全帽 | 0.927 | 0.929 | 0.919 |

对应的权重文件:https://pan.baidu.com/share/init?surl=iMZkRNXY1fowpQCcapFDqw,提取码: a66e

1

YOLOv5训练自己数据集教程

使用的数据集:Safety-Helmet-Wearing-Dataset ,感谢这位大神的开源数据集!

https://github.com/njvisionpower/Safety-Helmet-Wearing-Dataset

本文结合 YOLOv5官方教程 来写

环境准备

首先确保自己的环境:

Python >= 3.7

Pytorch == 1.5.x训练自己的数据

提示:

关于增加数据集分类的方法,请看【5. 增加数据集的分类】

1.1 创建自己的数据集配置文件

因为我这里只是判断 【人没有带安全帽】、【人有带安全帽】、【人体】 3个类别 ,基于 data/coco128.yaml 文件,创建自己的数据集配置文件 custom_data.yaml

# 训练集和验证集的 labels 和 image 文件的位置

train: ./score/images/train

val: ./score/images/val

# number of classes

nc: 3

# class names

names: ['person', 'head', 'helmet']1.2 创建每个图片对应的标签文件

使用标注工具类似于 Labelbox 、CVAT 、精灵标注助手 标注之后,需要生成每个图片对应的 .txt 文件,其规范如下:

每一行都是一个目标

类别序号是零索引开始的(从0开始)

每一行的坐标

class x_center y_center width height格式框坐标必须采用归一化的 xywh格式(从0到1)。如果您的框以像素为单位,则将

x_center和width除以图像宽度,将y_center和height除以图像高度。代码如下:

import numpy as np

def convert(size, box):

"""

将标注的 xml 文件生成的【左上角x,左上角y,右下角x,右下角y】标注转换为yolov5训练的坐标

:param size: 图片的尺寸:[w,h]

:param box: anchor box 的坐标 [左上角x,左上角y,右下角x,右下角y,]

:return: 转换后的 [x,y,w,h]

"""

x1 = int(box[0])

y1 = int(box[1])

x2 = int(box[2])

y2 = int(box[3])

dw = np.float32(1. / int(size[0]))

dh = np.float32(1. / int(size[1]))

w = x2 - x1

h = y2 - y1

x = x1 + (w / 2)

y = y1 + (h / 2)

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return [x, y, w, h]生成的 .txt 文件放置的名字是图片的名字,放置在 label 文件夹中,例如:

./score/images/train/00001.jpg # image

./score/labels/train/00001.txt # label生成的 .txt 例子

1 0.1830000086920336 0.1396396430209279 0.13400000636465847 0.15915916301310062

1 0.5240000248886645 0.29129129834473133 0.0800000037997961 0.16816817224025726

1 0.6060000287834555 0.29579580295830965 0.08400000398978591 0.1771771814674139

1 0.6760000321082771 0.25375375989824533 0.10000000474974513 0.21321321837604046

0 0.39300001866649836 0.2552552614361048 0.17800000845454633 0.2822822891175747

0 0.7200000341981649 0.5570570705458522 0.25200001196935773 0.4294294398277998

0 0.7720000366680324 0.2567567629739642 0.1520000072196126 0.23123123683035374 1.3 文件放置规范

文件树如下

1.4 聚类得出先验框(Yolov5 内部已做适配,可选)

使用代码 ./data/gen_anchors/clauculate_anchors.py ,修改数据集的路径

FILE_ROOT = r"xxx" # 根路径

ANNOTATION_ROOT = r"xxx" # 数据集标签文件夹路径

ANNOTATION_PATH = FILE_ROOT + ANNOTATION_ROOT跑完会生成一个文件 anchors.txt,里面有得出的建议先验框:

Best Accuracy = 79.72%

Best Anchors = [[14.74, 27.64], [23.48, 46.04], [28.88, 130.0], [39.33, 148.07], [52.62, 186.18], [62.33, 279.11], [85.19, 237.87], [88.0, 360.89], [145.33, 514.67]]1.5 选择一个您需要的模型

在文件夹 ./models 下选择一个你需要的模型然后复制一份出来,将文件开头的 nc = 修改为数据集的分类数,下面是借鉴 ./models/yolov5s.yaml来修改的

# parameters

nc: 3 # number of classes <============ 修改这里为数据集的分类数

depth_multiple: 0.33 # model depth multiple

width_multiple: 0.50 # layer channel multiple

# anchors

anchors: # <============ 根据 ./data/gen_anchors/anchors.txt 中的 Best Anchors 修改,需要取整(可选)

- [14,27, 23,46, 28,130]

- [39,148, 52,186, 62.,279]

- [85,237, 88,360, 145,514]

# YOLOv5 backbone

backbone:

# [from, number, module, args]

[[-1, 1, Focus, [64, 3]], # 0-P1/2

[-1, 1, Conv, [128, 3, 2]], # 1-P2/4

[-1, 3, BottleneckCSP, [128]],

[-1, 1, Conv, [256, 3, 2]], # 3-P3/8

[-1, 9, BottleneckCSP, [256]],

[-1, 1, Conv, [512, 3, 2]], # 5-P4/16

[-1, 9, BottleneckCSP, [512]],

[-1, 1, Conv, [1024, 3, 2]], # 7-P5/32

[-1, 1, SPP, [1024, [5, 9, 13]]],

[-1, 3, BottleneckCSP, [1024, False]], # 9

]

# YOLOv5 head

head:

[[-1, 1, Conv, [512, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 6], 1, Concat, [1]], # cat backbone P4

[-1, 3, BottleneckCSP, [512, False]], # 13

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 3, BottleneckCSP, [256, False]], # 17

[-1, 1, Conv, [256, 3, 2]],

[[-1, 14], 1, Concat, [1]], # cat head P4

[-1, 3, BottleneckCSP, [512, False]], # 20

[-1, 1, Conv, [512, 3, 2]],

[[-1, 10], 1, Concat, [1]], # cat head P5

[-1, 3, BottleneckCSP, [1024, False]], # 23

[[17, 20, 23], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

] 1.6 开始训练

这里选择了 yolov5s 模型进行训练,权重也是基于 yolov5s.pt 来训练

python train.py --img 640 --batch 16 --epochs 10 --data ./data/custom_data.yaml --cfg ./models/custom_yolov5.yaml --weights ./weights/yolov5s.pt其中,yolov5s.pt 需要自行下载放在本工程的根目录即可,下载地址 官方权重

1.7 看训练之后的结果

训练之后,权重会保存在 ./runs 文件夹里面的每个 exp 文件里面的 weights/best.py ,里面还可以看到训练的效果

2

推断

侦测图片会保存在 ./inferenct/output/ 文件夹下

运行命令:

python detect.py --source 0 # webcam

file.jpg # image

file.mp4 # video

path/ # directory

path/*.jpg # glob

rtsp://170.93.143.139/rtplive/470011e600ef003a004ee33696235daa # rtsp stream

http://112.50.243.8/PLTV/88888888/224/3221225900/1.m3u8 # http stream例如使用我的 s 权重检测图片,可以运行以下命令,侦测图片会保存在 ./inferenct/output/ 文件夹下

python detect.py --source 图片路径 --weights ./weights/helmet_head_person_s.pt3

检测危险区域内是否有人

3.1 危险区域标注方式

我这里使用的是 精灵标注助手 标注,生成了对应图片的 json 文件

3.2 执行侦测

侦测图片会保存在 ./inferenct/output/ 文件夹下

运行命令:

python area_detect.py --source ./area_dangerous --weights ./weights/helmet_head_person_s.pt 3.3 效果:在危险区域里面的人体会被 红色框 选出来

4

生成 ONNX

4.1 安装 onnx 库

pip install onnx 4.2 执行生成

python ./models/export.py --weights ./weights/helmet_head_person_s.pt --img 640 --batch 1onnx 和 torchscript 文件会生成在 ./weights 文件夹中

5

增加数据集的分类

关于增加数据集分类的方法:

SHWD 数据集里面没有 person 的类别,先将现有的自己的数据集执行脚本生成yolov5需要的标签文件.txt,之后再用yolov5x.pt 加上 yolov5x.yaml ,使用指令检测出人体

python detect.py --save-txt --source ./自己数据集的文件目录 --weights ./weights/yolov5x.ptyolov5 会推理出所有的分类,并在 inference/output 中生成对应图片的 .txt 标签文件;修改 ./data/gen_data/merge_data.py 中的自己数据集标签所在的路径,执行这个python脚本,会进行 person 类型的合并。

下载1:OpenCV-Contrib扩展模块中文版教程

在「小白学视觉」公众号后台回复:扩展模块中文教程,即可下载全网第一份OpenCV扩展模块教程中文版,涵盖扩展模块安装、SFM算法、立体视觉、目标跟踪、生物视觉、超分辨率处理等二十多章内容。

下载2:Python视觉实战项目52讲

在「小白学视觉」公众号后台回复:Python视觉实战项目,即可下载包括图像分割、口罩检测、车道线检测、车辆计数、添加眼线、车牌识别、字符识别、情绪检测、文本内容提取、面部识别等31个视觉实战项目,助力快速学校计算机视觉。

下载3:OpenCV实战项目20讲

在「小白学视觉」公众号后台回复:OpenCV实战项目20讲,即可下载含有20个基于OpenCV实现20个实战项目,实现OpenCV学习进阶。

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~智能推荐

CSS 鼠标悬浮在图片上添加遮罩层效果的实现_css 悬浮遮罩进行操作怎么操作-程序员宅基地

文章浏览阅读2.3k次,点赞3次,收藏6次。实现的关键是 CSS 的opacity和hover,本文也主要介绍遮罩层的实现父级元素 sub-module-type 要display: block;position: relative;子级元素 mask 遮罩层 position: absolute;opacity: 0;pointer-events:none;鼠标悬浮时 opacity: 1; <div class="sub-module"> <div class="sub-modul..._css 悬浮遮罩进行操作怎么操作

ora-64203:Destination buffer too small to hold CLOB data after character set conversion.-程序员宅基地

文章浏览阅读2.8k次。ora-64203:Destination buffer too small to hold CLOB data after character set conversion.拼接字符串时过长引起,报缓冲区太小错误SELECT WM_CONCAT(field_A|| field_b) FROM table_A WHERE fie..._destination buffer too small to hold clob data after character set conversio

ThinkPHP 数据库操作(三) : 查询方法、查询语法、链式操作_thinkphp db where-程序员宅基地

文章浏览阅读3.5k次。查询方法条件查询方法where 方法可以使用 where 方法进行 AND 条件查询:Db::table('think_user') ->where('name','like','%thinkphp') ->where('status',1) ->find();多字段相同条件的 AND 查询可以简化为如下方式:Db::table('think_user') ->where('name&title','like','%_thinkphp db where

在Java中,使用HttpUtils实现发送HTTP请求_java httputils-程序员宅基地

文章浏览阅读1.4k次。HTTP请求,在日常开发中,还是比较常见的,今天给大家分享HttpUtils如何使用。阅读本文,你将收获:简单总结HTTP请求常用配置;JavaLib中HttpUtils如何使用;如何封装HTTP请求工具类。_java httputils

解决loadrunner 12 录制时打不开Chrome谷歌浏览器,显示正在加载中的问题_loadrunner12录制脚本打不开谷歌浏览器-程序员宅基地

文章浏览阅读8.6k次,点赞12次,收藏18次。loadrunner 12 录制时打不开谷歌浏览器,一直显示正在加载的问题刚开始学习loadrunner,安装了loadrunner 12,录制时浏览器一直显示正在加载…看到网上有人说录制的时候打开Fiddler就可以了,试了下确实可以。但如果录制的时候打开Fiddler,那么回放时也需要借助Fiddler才能正常回放。后来折腾了很久发现可以这么设置1. 在开始录制时的录制选项(Recor..._loadrunner12录制脚本打不开谷歌浏览器

对人工智能的看法_对人工智能的了解、认知和判断-程序员宅基地

文章浏览阅读632次。不必害怕人工智能,去认识、学习、掌握它才是正确的,打铁还需自身硬。_对人工智能的了解、认知和判断

随便推点

物联网应用开发实践案例-智慧农业_物联网农业项目案例-程序员宅基地

文章浏览阅读1.1k次。1. 设计需求、硬件环境介绍1.1 项目背景近几年,物联网、智能家居、AI人工智能技术发送非常迅速。在物联网技术的支撑下,如今农业逐渐走向现代化,自动化、现在智能化的农业生产成为了主流。告别“刀耕火种”的传统农业后,现代农业也正在向智慧型转变,当前智慧农业模式已经深入到农业生产的各个环节,灌溉、施肥、植保等细分领域都将与物联网、信息技术等先进科技相结合,效率、效果也将得到大大提高。要知道,所谓的“智慧农业”就是充分应用现代信息技术成果,集成应用计算机技术与网络技术、物联网技术、无线通信技术以及专家智慧_物联网农业项目案例

【nifi数据采集】nifi给kafka打数据遇到的坑 - kafka2.1 的listeners配置_nifi consumerkafkarecord-程序员宅基地

文章浏览阅读4.3k次。如下图,在测试使用nifi往kafka打数据的时候,发现通过ambari安装的kafka收不到数据,而通过docker安装的kafka则可以收到数据。nifi后台log日志报错信息2020-04-19 11:09:02,916 INFO [Timer-Driven Process Thread-10] o.a.kafka.common.utils.AppInfoParser Kafka ..._nifi consumerkafkarecord

ide小技巧_zhile.io-程序员宅基地

文章浏览阅读730次。目录前言一.安装toolbox二.安装ide三.添加插件说明:前言 ide的工具都是要花钱购买的,那么有一种无限薅羊毛的方法,是不是就特别爽呢?话不多说,直接进入正题。一.安装toolbox首先去下载iea全家桶下载的工具,这个工具里面有最近几个版本的ide。特别说明一下,ide2021的版本都是要先登录才能试用,那么2020的就没有这个要求了,它们支持直接进入试用!咱们可以去官网直接下载toolbox,JetBrains Too..._zhile.io

Docker 快速安装Jenkins完美教程(解决无法安装插件问题)_docker 安装jenkins 无法安装git插件-程序员宅基地

文章浏览阅读3.7k次,点赞2次,收藏12次。一、前言有人问,为什么要用Jenkins?我说下我以前开发的痛点,在一些中小型企业,每次开发一个项目完成后,需要打包部署,可能没有专门的运维人员,只能开发人员去把项目打成一个war包,可能这个项目已经上线了,需要把服务关,在部署到服务器上,将项目启动起来,这个时候可能某个用户正在操作某些功能上的东西,如果你隔三差五的部署一下,这样的话对用户的体验也不好,自己也是烦的很,总是打包拖到服务器上。希望小型企业工作人员学习一下,配置可能复杂,但是你配置好了之后,你只需要把代码提交到Git或者Svn上,自动构建部署_docker 安装jenkins 无法安装git插件

【python初级】 ModuleNotFoundError: No module named paho_modulenotfounderror: no module named 'paho-程序员宅基地

文章浏览阅读8.2k次,点赞3次,收藏3次。【python初级】 ModuleNotFoundError: No module named paho1、背景2、解决1、背景python3在导入mqtt时报错,具体如下:Traceback (most recent call last): File "E:/E05_Project/mqtt_server.py", line 17, in <module> import paho.mqtt.client as mqttModuleNotFoundError: No modu_modulenotfounderror: no module named 'paho

fatal error: opencv2/freetype.hpp: 没有那个文件或目录 - opencv_contrib_没有 opencv2/freetype.hpp-程序员宅基地

文章浏览阅读5.1k次。fatal error: opencv2/freetype.hpp: 没有那个文件或目录 - opencv_contrib1. freetype.hpp fileopencv2https://docs.opencv.org/4.2.0/dc/d8f/freetype_8hpp.htmlopencv_contrib -> modules -> freetype -> include -> opencv2https://docs.opencv.org/3.2.0/dc/d8f/_没有 opencv2/freetype.hpp